📖 この記事で分かること

・Google MapsにGemini AIが搭載されて何が変わるのか

・声だけで地図アプリを操作できる新機能の詳細

・あなたの運転体験がどう便利になるか

・いつから使えるようになるのか

💡 知っておきたい用語

・Gemini AI【ジェミニ(ジェミナイ) エーアイ】:Googleが開発した最新の人工知能。人間の質問を理解し、自然な会話で答えてくれるシステム

最終更新日: 2025年11月17日

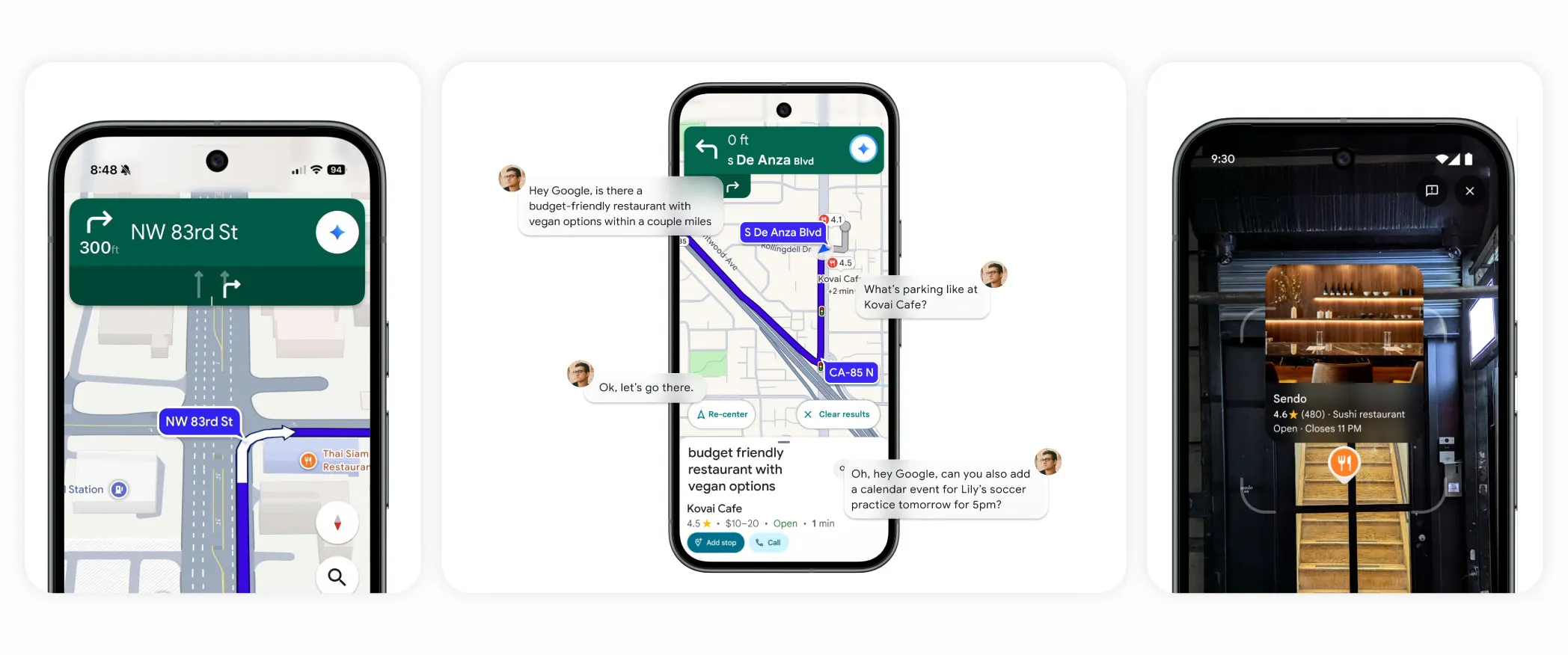

Google MapsにGemini AIが統合され、ナビゲーションアプリの使い方が根本から変わろうとしています。[1] 2025年11月に発表されたこの新機能により、運転中でも音声だけで複雑な操作が可能になります。

音声だけで全てが完結する新体験

実に興味深いのは、今回の統合がただの音声認識機能ではないことです。[2] Gemini AIの搭載により、従来の「コンビニを検索」といった単純な指示から、「子供が喜びそうな遊び場を近くで探して」のような複雑で曖昧なリクエストまで理解できるようになりました。

開発現場で長年地図APIと格闘してきた経験からすると、これは想像以上の技術的飛躍です。従来のシステムでは不可能だった「文脈を理解した検索」が実現されています。

ハンズフリーで可能になること

新しいGoogle Mapsでは、以下のような操作が音声のみで可能になります:

- 場所の検索と追加: 「美味しいラーメン店を経由地に追加して」

- 交通情報の報告: 「前方で事故が発生しています」

- ルート変更: 「渋滞を避けた別の道を案内して」

- 施設情報の確認: 「目的地のお店は何時まで開いてますか?」

ランドマーク認識で道案内が劇的に改善

注目すべきは、Gemini AIとStreet Viewデータを組み合わせた新しいナビゲーション機能です。[1] 従来の「200m先を右折」ではなく、「スターバックスの角を右折してください」のような、実際の建物や店舗を目印にした案内が可能になります。

これって実は、運転初心者や土地勘のない場所でのナビゲーションを劇的に改善する機能なんです。個人的にも、知らない街での運転では目印があると格段に分かりやすいと感じていました。

開発者視点で見る技術的な驚き

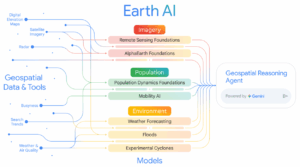

Gemini APIとGoogle Maps Platformの統合は、技術的に見ても実に興味深い実装です。[3] 2025年10月17日に一般提供が開始されたGemini API経由でのGoogle Maps統合により、2億5000万以上の場所データがAIで活用できるようになりました。

これにより、開発者はより賢いロケーションベースのアプリケーション構築が可能になります。旅行、不動産、小売、物流といった分野での応用が期待されています。

いつから使えるようになるのか

現在、これらの新機能は段階的にロールアウト中です。[1] ハンズフリー操作機能とランドマークベースナビゲーションは「まもなく展開予定」とされており、地域によって提供開始時期が異なる見込みです。

今後への期待と注意点

Google Mapsの進化は止まりそうにありません。ただ、新しい技術には慣れが必要です。音声認識の精度向上とプライバシー保護のバランスも重要な課題となるでしょう。

個人的には、クリエイティブワークでの移動中にもインスピレーションを得られる場所検索ができそうで、早く使ってみたいと思っています。

よくある質問

Q: Gemini AI搭載のGoogle Mapsはいつから使えますか?

A: 現在段階的にロールアウト中で、地域により提供時期が異なります。日本での具体的な開始時期は未発表です。

Q: 既存のGoogle Mapsアプリで自動的に使えるようになりますか?

A: はい、アプリのアップデートを通じて新機能が追加される予定です。

Q: 音声操作はオフラインでも利用できますか?

A: Gemini AIを活用した高度な機能はインターネット接続が必要と予想されますが、詳細は公式発表を待つ必要があります。

まとめ

Google MapsへのGemini AI統合は、単なる機能追加ではなく、地図アプリの概念を根本から変える革新です。音声だけでの複雑な操作、ランドマークを活用した直感的なナビゲーション、そして文脈を理解したAI検索により、運転体験が大幅に向上することが期待されます。

技術的な観点からも、250万以上の場所データとAIの組み合わせは、今後のロケーションベースサービスの方向性を示す重要な事例といえるでしょう。新機能の展開が待ち遠しいですね。

【用語解説】

- Gemini AI【ジェミナイ エーアイ】: Googleが開発した最新の人工知能システム。人間の自然な言葉を理解し、会話形式で応答できる

- API【エーピーアイ】: Application Programming Interfaceの略。アプリケーション同士が情報をやり取りするための仕組み

- ハンズフリー: 手を使わずに操作すること。主に音声操作を指す

- ランドマーク: 目印となる建物や施設。ナビゲーションで道案内の基準点として使用される

- ロールアウト: 新機能やサービスを段階的に展開・提供すること

免責事項: 本記事の情報は執筆時点のものです。必ず最新情報をご確認ください。AI技術は急速に進歩しているため、機能や制限は予告なく変更される場合があります。

Citations:

[1] https://blog.google/products/maps/gemini-navigation-features-landmark-lens/

[2] https://techcrunch.com/2025/11/05/google-maps-bakes-in-gemini-to-improve-navigation-and-hands-free-use/

[3] https://www.vktr.com/ai-news/google-maps-integration-expands-gemini-api-capabilities/